Nach dreijähriger Vorlaufzeit wurde final über den AI Act abgestimmt und mit überwältigender Mehrheit angenommen. In Straßburg lebt die Hoffnung, dass das Gesetz weltweit Nachahmer findet. Für Unternehmen beginnt eine Zeit der Umstellung.

Es ist endlich so weit. Nach Monaten der Verhandlungen, Abstimmungen und Anpassungen wurde heute Mittwoch final über den AI Act entschieden. Digitalkommissar Thierry Breton veröffentlichte umgehend das Ergebnis auf X: „Demokratie 1; Lobby 0“. 618 Abgeordnete haben abgestimmt und 523 davon haben dem AI Act zugestimmt. Es gab 46 Stimmen dagegen und 49 Enthaltungen. Was der AI Act bedeutet und welche Änderungen er mit sich bringt.

Mit diesem Gesetz werden KI-Systeme in Kategorien eingeteilt: Je höher die potenziellen Gefahren, umso höher die Anforderungen. Für Entwickler, Unternehmen und Anbieter derartiger Technologien bringt das Gesetz zahlreiche Vorgaben. Doch der AI Act stößt auch auf Widerstand. Der Verein Algorithm Watch kritisiert „eklatante Lücken“ vor allem im Bereich der Massenüberwachung.

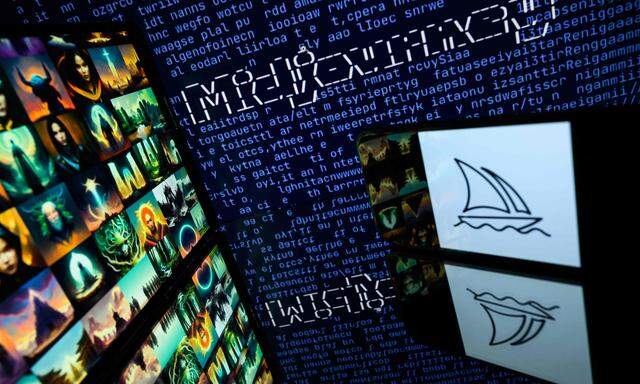

Die künstliche Intelligenz birgt völlig neue Chancen für Unternehmen, doch sie bringt auch eine Vielzahl an unbekannten Variablen. Und genau mit diesen beschäftigt sich die EU. Schon bevor Chat GPT das Thema massentauglich machte, setzte man sich an einen gesetzlichen Rahmen. Geeinigt hat man sich auf eine Unterteilung in Risikogruppen. Je höher die Gefahren einer Anwendung sind, umso mehr Auflagen müssen erfüllt werden. Damit soll sichergestellt sein, dass die Systeme transparent und nachvollziehbar arbeiten. In allen Gruppen gibt es einen wichtigen gemeinsamen Punkt: die KI soll von Menschen überwacht und kontrolliert werden.

Vier verschiedene Kategorien gibt es:

1. unannehmbares Risiko – dazu zählen biometrische Erkennung in Echtzeit (Bsp. China) und auch der Einsatz von KI-Systemen am Arbeitsplatz, um die Emotionen der Mitarbeiter auszulesen und zu überwachen

2. hohes Risiko – Einsatz in Bildung und Strafverfolgung - nur unter bestimmten Sicherheitsbestimmungen, wie der Durchführung einer Risikobewertung der Grundrechte

3. begrenztes Risiko – Generative KI wie Chat GPT, Gemini, Galaxy AI - mit der Vorgabe, dass die Inhalte auch als solche gekennzeichnet werden müssen. Stichwort Wasserzeichen

4. geringes Risiko – KI-Systeme für Spam-Filter

Ausnahmen: Das Gesetz schließt vom Anwendungsbereich folgendes aus:

1. KI-Modelle oder -Systeme, die ausschließlich zum Zweck der wissenschaftlichen Forschung verwendet werden

2. Verwendung von KI-Systemen für reine Haushaltstätigkeiten

3. KI-Systeme, die ausschließlich für Verteidigungs- oder Militärzwecke verwendet werden

Warum die strengen Auflagen? Chat GPT (OpenAI) und Gemini (Google) und all die anderen Systeme verändern bereits jetzt, wie wir Inhalte wahrnehmen. Fake News, Desinformationskampagnen und manipulierte Bilder sind bereits jetzt schwer zu identifizieren. Doch generative KI, wie diese genannt wird, bei der Menschen per Text Vorgaben machen und die KI diese anhand riesiger Datenbanken erfüllt, ist nur ein kleiner Bruchteil dessen, wofür KI eingesetzt werden kann. In der Medizin, Forschung, Bildung und Strafverfolgung. Doch besonders letztere brauche strenge Regeln, fordern die Verantwortlichen von Algorithm Watch.

Eine Überwachung wie sie in China möglich ist, dürfe nicht als Beispiel für europäische Länder dienen. Das Gesetz weise aber „eklatante Lücken“ auf. Darum fordere man Deutschland auf „biometrische Erkennung im öffentlichen Raum zu verbieten“. Zwar sei ein Verbot durchaus im AI Act verankert, aber die „Vielzahl an Ausnahmen“ sei besorgniserregend: „Die Durchführung biometrischer Echtzeit-Fernidentifikation im öffentlichen Raum öffnet die Tür in dystopische Verhältnisse, in denen jeder Mensch bei jeder Bewegung im öffentlichen Raum permanent identifizierbar und überwachbar wird.“

Hoffnung auf internationales Beispiel

Der AI Act gilt künftig für alle, die KI-Systeme in der EU entwickeln, oder sie in der EU anbieten und auch nutzen; unabhängig davon ob öffentliche oder private Unternehmen. Doch die EU hofft darauf, dass der AI Act international Anklang findet und Vorbildwirkung hat.

Damit würden die Abgeordneten einen bereits von Unterhändlern des Parlaments und der EU-Länder ausgehandelten Kompromiss absegnen. Dieser geht auf einen Vorschlag der EU-Kommission aus dem Jahr 2021 zurück. Künstliche Intelligenz bezeichnet meist Anwendungen auf Basis maschinellen Lernens, bei denen eine Software große Datenmengen nach Übereinstimmungen durchforstet und daraus Schlussfolgerungen zieht. Sie werden schon jetzt in vielen Bereichen eingesetzt. Zum Beispiel können solche Programme Aufnahmen von Computertomografen schneller und mit einer höheren Genauigkeit als Menschen auswerten.

Wie geht es weiter?

Nachdem der AI Act heute in Straßburg angenommen wurde, tritt dieser 20 Tage nach Veröffentlichung im Journal in Kraft. Daraufhin haben EU-Mitgliedsländer sechs Monate Zeit, um die Vorgaben zu übernehmen - vor allem hinsichtlich der AI-Kategorien eins und zwei. Zwei Jahre nach Inkrafttreten kommt es zur Anwendung des AI Acts; mitsamt den Strafen, die bei Nichtbeachtung verhängt werden können. Vom Vorschlag bis zur finalen Abstimmung hat es knapp drei Jahre gedauert. (stein)